Quelques chiffres révélés par Facebook lors d'une conférence de presse et publiés par TechCrunch.

Des chiffres "Big Data" qui se passent de commentaires…

Chaque jour :

- 2,5 milliards d'objets traités

- 500 To de nouvelles données traitées

- 2,7 milliards de "like"

- 300 millions de photos intégrées

- 70 000 requêtes

et… 210 To de données Hadoop (via Hive) manipulées… chaque heure !

En stock :

- 100 Po de données sur une seule grappe Hadoop

Les mauvais esprits ajouteront un chiffre :

- Cours de bourse : -31 % en un mois de cotation… celui-ci aussi sans commentaire…

Des chiffres "Big Data" qui se passent de commentaires…

Chaque jour :

- 2,5 milliards d'objets traités

- 500 To de nouvelles données traitées

- 2,7 milliards de "like"

- 300 millions de photos intégrées

- 70 000 requêtes

et… 210 To de données Hadoop (via Hive) manipulées… chaque heure !

En stock :

- 100 Po de données sur une seule grappe Hadoop

Les mauvais esprits ajouteront un chiffre :

- Cours de bourse : -31 % en un mois de cotation… celui-ci aussi sans commentaire…

Par Philippe Nieuwbourg le Jeudi 23 Août 2012

|

1 commentaire

Les scénaristes et réalisateurs de films ont toujours été en avance, tout comme les auteurs de romans de science-fiction, sur les technologies. Son imagination sans limite a permis à Jules Verne d'imaginer la conquête spatiale, les sous-marins, la spéléologie, etc.

Plus proche de nous, les films d'anticipation sont une bonne source de réflexion sur le sujet du Big Data. La question n'est pas de savoir si dans le futur nous porterons des combinaisons argentées et nous nourrirons de pilules, mais de prolonger la réalité pour imaginer ce qu'elle sera demain, tout en la gardant plausible.

Et en matière de Big Data, nous sommes servis ! Même si le sujet et les architectures techniques ne sont presque jamais directement évoqués dans ces films, plusieurs films d'anticipation nous racontent comment les données influenceront notre vie, dans quelques années ou décennies. Dans le cadre de la rédaction de mon livre, je me suis donc plié à de longues séances de visionnage.

Afin de couper court à toute remarque ironique de certains d'entre vous, oui, c'est une facette intéressante du travail de recherche; mais non, ce n'est pas toujours une partie de plaisir.

D'abord parce que tous les films ne sont pas des chef-d'oeuvres. Certains ont un peu vieilli, comme Bienvenue à Gattaca qui manque cruellement de rythme. Et pour tous, regarder un film avec à portée de main un bloc et un crayon, pour noter idées et citations en temps réel, ainsi que leur position exacte dans le film, ne permet pas véritablement de plonger dans l'intrigue. Mais je ne me plains pas !

D'abord parce que j'admire le processus créatif des auteurs. Je repense souvent à Minority Report qui en 2002, il y a dix ans, nous parlait d'analyse prédictive, d'interfaces naturelles, etc. Les deux sont devenues réalités : Microsoft Kinect nous permet de jouer à Minority Report dans notre salon. Quant à SAS et SPSS, ils ont été retenus par plusieurs services de police qui prépositionnent aujourd'hui leurs effectifs là où un crime va, statistiquement, se produire.

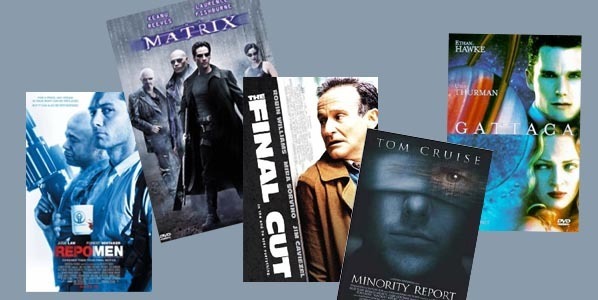

Alors quels films illustrent le mieux l'avenir du Big Data et son impact sur notre vie quotidienne ?

Voici les films que j'ai sélectionné :

- Minority Report : on y parle d'analyse prédictive, d'anticipation des événements, etc. et même si les données proviennent en 2054 du cerveau des extra-lucides installés au ministère de la justice et non d'un ordinateur, la réflexion sur la prédictibilité des événements et la prise de décision est intéressante.

- Matrix : la matrice est sans doute le meilleur exemple de Big Data de l'histoire du cinéma.

- The Final Cut : votre vie est enregistrée sous forme de vidéo, des centaines de milliers d'heures qui gardent en mémoire toute votre existence. A votre mort, des monteurs transforment cela en un film mémoriel afin que le meilleur soit conservé et le pire oublié. Du point de vue technologique, nous ne sommes plus très loin d'en être capable.

- Repo Men : Lors d'un accident de santé, on vous implante sans votre consentement, un organe artificiel que vous devez ensuite payer chaque mois. Si vous n'en avez plus les moyens, la société vient vous le reprendre ! Moins directement en rapport avec le big data, le film est néanmoins rempli de références technologies intéressantes.

- Gattaca : dans le monde de Gattaca, le séquençage de l'ADN se fait à la naissance, instantanément, et sert d'identification numérique tout au long de votre vie. Vos risques sont mesurés dès la naissance, et pour espérer un avenir, vous devez faire partie de l'élite. Mon rendez-vous avec Philippe Hupé de l'Institut Curie, m'a confirmé là encore que nous nous approchons petit à petit de la capacité technologique à faire de Gattaca un monde possible… mais pas souhaitable bien sur.

Avez-vous d'autres suggestions de films qui nous racontent une histoire du Big Data ? N'hésitez pas à utiliser les commentaires ci-dessous pour me faire part de vos suggestions.

Je cherche en particulier le titre d'un film dont je n'ai que quelques souvenirs : on y parle d'assurances maladies qui ne vous prennent en charge que si vous respectez certains engagements (ne pas fumer, manger sain…); chaque matin une analyse d'urine confirme si l'assureur accepte toujours de vous couvrir. Le héros conserve des flacons de ses jours sobres et tente de tromper le détecteur. Malheureusement il a un accident; les tests sont refaits à l'hôpital et l'assureur annule sa prise en charge… Quelqu'un peut-il m'aider à retrouver ce film ?

Afin de couper court à toute remarque ironique de certains d'entre vous, oui, c'est une facette intéressante du travail de recherche; mais non, ce n'est pas toujours une partie de plaisir.

D'abord parce que tous les films ne sont pas des chef-d'oeuvres. Certains ont un peu vieilli, comme Bienvenue à Gattaca qui manque cruellement de rythme. Et pour tous, regarder un film avec à portée de main un bloc et un crayon, pour noter idées et citations en temps réel, ainsi que leur position exacte dans le film, ne permet pas véritablement de plonger dans l'intrigue. Mais je ne me plains pas !

D'abord parce que j'admire le processus créatif des auteurs. Je repense souvent à Minority Report qui en 2002, il y a dix ans, nous parlait d'analyse prédictive, d'interfaces naturelles, etc. Les deux sont devenues réalités : Microsoft Kinect nous permet de jouer à Minority Report dans notre salon. Quant à SAS et SPSS, ils ont été retenus par plusieurs services de police qui prépositionnent aujourd'hui leurs effectifs là où un crime va, statistiquement, se produire.

Alors quels films illustrent le mieux l'avenir du Big Data et son impact sur notre vie quotidienne ?

Voici les films que j'ai sélectionné :

- Minority Report : on y parle d'analyse prédictive, d'anticipation des événements, etc. et même si les données proviennent en 2054 du cerveau des extra-lucides installés au ministère de la justice et non d'un ordinateur, la réflexion sur la prédictibilité des événements et la prise de décision est intéressante.

- Matrix : la matrice est sans doute le meilleur exemple de Big Data de l'histoire du cinéma.

- The Final Cut : votre vie est enregistrée sous forme de vidéo, des centaines de milliers d'heures qui gardent en mémoire toute votre existence. A votre mort, des monteurs transforment cela en un film mémoriel afin que le meilleur soit conservé et le pire oublié. Du point de vue technologique, nous ne sommes plus très loin d'en être capable.

- Repo Men : Lors d'un accident de santé, on vous implante sans votre consentement, un organe artificiel que vous devez ensuite payer chaque mois. Si vous n'en avez plus les moyens, la société vient vous le reprendre ! Moins directement en rapport avec le big data, le film est néanmoins rempli de références technologies intéressantes.

- Gattaca : dans le monde de Gattaca, le séquençage de l'ADN se fait à la naissance, instantanément, et sert d'identification numérique tout au long de votre vie. Vos risques sont mesurés dès la naissance, et pour espérer un avenir, vous devez faire partie de l'élite. Mon rendez-vous avec Philippe Hupé de l'Institut Curie, m'a confirmé là encore que nous nous approchons petit à petit de la capacité technologique à faire de Gattaca un monde possible… mais pas souhaitable bien sur.

Avez-vous d'autres suggestions de films qui nous racontent une histoire du Big Data ? N'hésitez pas à utiliser les commentaires ci-dessous pour me faire part de vos suggestions.

Je cherche en particulier le titre d'un film dont je n'ai que quelques souvenirs : on y parle d'assurances maladies qui ne vous prennent en charge que si vous respectez certains engagements (ne pas fumer, manger sain…); chaque matin une analyse d'urine confirme si l'assureur accepte toujours de vous couvrir. Le héros conserve des flacons de ses jours sobres et tente de tromper le détecteur. Malheureusement il a un accident; les tests sont refaits à l'hôpital et l'assureur annule sa prise en charge… Quelqu'un peut-il m'aider à retrouver ce film ?

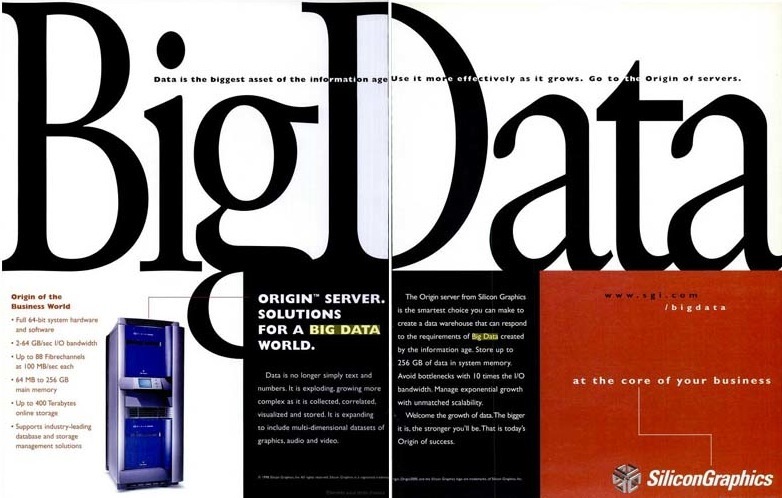

Vous pensiez que le Big Data était une invention récente; un mot-clef marketing imaginé dans la Silicon Valley ces deux dernières années pour faire vendre plus de machines, plus de logiciels… et bien pas du tout !

D'après mes recherches, la première société informatique à avoir véritablement exploité et publicisé ce concept de Big Data est Silicon Graphics. Et nous sommes en 1997, le 17 novembre, le terme Big Data apparait dans une publicité pour sa gamme de serveurs "Origin" dans le magazine InfoWorld [Silicon Graphics. (1997, November 17). Publicité Silicon Graphics. InfoWorld, 19(46), 30]. Et quelques mois plus tard, c'est toute la publicité pour ce serveur qui bénéficie du slogan de "Big Data". Le 2 mars 1998 dans une autre publicité, le discours est clairement semblable à celui que nous relayons aujourd'hui. Extrait : "Data is no longer simply text and numbers. It is exploding, growing more complex as it is collected, correlated, visualized and stored. It is expanding to include multi-dimensional datasets of graphics, audio and video.

The Origin Server from Silicon Graphics is the smartest choice you can make to create a data warehouse that can respond to the requirements of Big Data created by the information age. Store up to 256 Gb of data in a system memory. Avoid bottlenecks with 10 times the I/O bandwith. Manage exponential growth with unmatched scalability. Welcome the growth of data. The bigger it is the stronger you'll be. That is today's Origin of success". [Silicon Graphics. (1998, March 2). Publicité Silicon Graphics. InfoWorld, 20(9), 52].

Et même le site web de Silicon Graphics est de la partie puisqu'une URL dédiée est créée http://www.sgi.com/bigdata. Elle n'est plus active aujourd'hui… dommage.

Comme je l'avais écrit dans Decideo, une présentation de John Mashey, alors "Chief Scienstist" chez SGI confirme l'intérêt que portait l'entreprise à ce concept. John Mashey vient d'ailleurs de me le confirmer directement par email : "Je faisais tout mon possible pour que la gestion des données et des entrées/sorties soit une des priorités chez SGI. Nous avons fabriqué des ordinateurs avec de fantastiques entrées/sorties et des systèmes de gestion de gros fichiers, mais parfois nous ne les avons pas promus comme ils auraient du l'être". John Mashey refuse avec modestie de s'attribuer l'invention du terme "big data", mais il reconnait qu'il "a certainement fait plus que presque tout autre chez SGI pour évangéliser" le "Big Data".

The Origin Server from Silicon Graphics is the smartest choice you can make to create a data warehouse that can respond to the requirements of Big Data created by the information age. Store up to 256 Gb of data in a system memory. Avoid bottlenecks with 10 times the I/O bandwith. Manage exponential growth with unmatched scalability. Welcome the growth of data. The bigger it is the stronger you'll be. That is today's Origin of success". [Silicon Graphics. (1998, March 2). Publicité Silicon Graphics. InfoWorld, 20(9), 52].

Et même le site web de Silicon Graphics est de la partie puisqu'une URL dédiée est créée http://www.sgi.com/bigdata. Elle n'est plus active aujourd'hui… dommage.

Comme je l'avais écrit dans Decideo, une présentation de John Mashey, alors "Chief Scienstist" chez SGI confirme l'intérêt que portait l'entreprise à ce concept. John Mashey vient d'ailleurs de me le confirmer directement par email : "Je faisais tout mon possible pour que la gestion des données et des entrées/sorties soit une des priorités chez SGI. Nous avons fabriqué des ordinateurs avec de fantastiques entrées/sorties et des systèmes de gestion de gros fichiers, mais parfois nous ne les avons pas promus comme ils auraient du l'être". John Mashey refuse avec modestie de s'attribuer l'invention du terme "big data", mais il reconnait qu'il "a certainement fait plus que presque tout autre chez SGI pour évangéliser" le "Big Data".

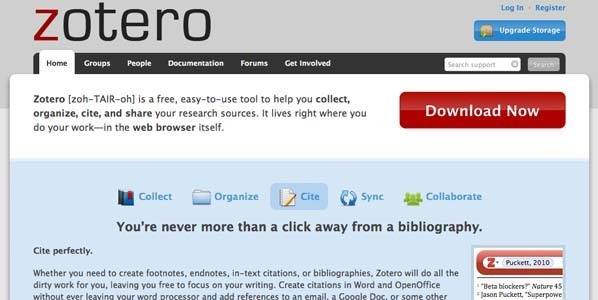

Encore une histoire d'outils aujourd'hui. Car la rédaction d'un livre nécessite beaucoup de manipulation de données : citations, interviews, références, etc. Hors de question bien sur de m'approprier un contenu dont je ne sois pas l'auteur. Et comme j'ambitionne que ce premier livre en français sur le big data soit également préconisé par certains enseignants, je me dois d'être rigoureux sur le sujet. Sans doute la fréquentation depuis un an de mes amis et collègues de l'UQAM y est-elle pour quelque chose… moi qui n'avait jamais mis les pieds à l'université avant d'y enseigner, je découvre certaines pratiques, et je les apprends sur le tas.

Citations, références, bibliographie… donc, voici mon sujet du jour. Alors bien sur, il est possible de gérer tout cela manuellement, ou dans un simple traitement de texte. Mais sur 250 pages de texte, je devrais bien arriver à 200 ou 300 références… et comme tout geek qui se respecte, face à un problème, je me fais plaisir en cherchant un outil :-)

Scrivener que je vous ai décrit en début de semaine, dispose d'une fonction pour gérer les citations et créer ainsi les notes de bas de page avec les références complètes de ce que vous citez.

Mais un paramètre qui permet de lier Scrivener à un éditeur de références externes (Bibliography / citations manager) a attiré mon attention. Je ne connais pas du tout ce domaine. Et me voici plongé dans les forums pour découvrir ce marché.

Si vous souhaitez vous-aussi faire le tour des outils, voici deux liens qui vous conduiront directement vers tous les outils du marché :

- http://en.wikipedia.org/wiki/Comparison_of_reference_management_software

- http://www.library.wisc.edu/citation-managers/comparison.html

Après avoir lu tout cela en détail, je comprends que deux outils figurent un peu sur le dessus du panier, Zotero et [EndNote]http://www.endnote.com/. Ils semblent en tous cas les plus cités par les chercheurs et rédacteurs. Ma présélection étant faite, il me faut maintenant comparer ces deux bons logiciels. Je tombe justement sur une excellente comparaison, qui semble objective, sur le site ProfHacker

Ma première impression est confirmée, les deux outils sont très proches et tous deux conviendraient certainement à mon usage de débutant en la matière.

Je choisis finalement Zotero pour plusieurs raisons : il est gratuit (alors que EndNote coute quand même 250 $), son format de données est ouvert et je pourrais facilement transférer ma base de références dans un autre outil si nécessaire, il semble doté de fonctions de synchronisation avancées qui me plaisent car je travaille en permanence sur plusieurs machines. Et pour finir c'est un projet universitaire qui me plait bien, alors que EndNote est édité par Thomson Reuters… qui n'a pas vraiment besoin de mon argent :-)

C'est donc parti pour Zotero, et je vais commencer à l'alimenter avec l'ensemble de mes recherches. Pas certains que je trouverai le temps de tout basculer, mais je vais plutôt l'utiliser au fil de l'eau à partir de maintenant. Et je vous ferai bien sur un retour sur mon expérience.

Et si vous voulez voir cela en vidéo, en quelques minutes, voici le lien : http://www.zotero.org/support/quick_start_guide

Scrivener que je vous ai décrit en début de semaine, dispose d'une fonction pour gérer les citations et créer ainsi les notes de bas de page avec les références complètes de ce que vous citez.

Mais un paramètre qui permet de lier Scrivener à un éditeur de références externes (Bibliography / citations manager) a attiré mon attention. Je ne connais pas du tout ce domaine. Et me voici plongé dans les forums pour découvrir ce marché.

Si vous souhaitez vous-aussi faire le tour des outils, voici deux liens qui vous conduiront directement vers tous les outils du marché :

- http://en.wikipedia.org/wiki/Comparison_of_reference_management_software

- http://www.library.wisc.edu/citation-managers/comparison.html

Après avoir lu tout cela en détail, je comprends que deux outils figurent un peu sur le dessus du panier, Zotero et [EndNote]http://www.endnote.com/. Ils semblent en tous cas les plus cités par les chercheurs et rédacteurs. Ma présélection étant faite, il me faut maintenant comparer ces deux bons logiciels. Je tombe justement sur une excellente comparaison, qui semble objective, sur le site ProfHacker

Ma première impression est confirmée, les deux outils sont très proches et tous deux conviendraient certainement à mon usage de débutant en la matière.

Je choisis finalement Zotero pour plusieurs raisons : il est gratuit (alors que EndNote coute quand même 250 $), son format de données est ouvert et je pourrais facilement transférer ma base de références dans un autre outil si nécessaire, il semble doté de fonctions de synchronisation avancées qui me plaisent car je travaille en permanence sur plusieurs machines. Et pour finir c'est un projet universitaire qui me plait bien, alors que EndNote est édité par Thomson Reuters… qui n'a pas vraiment besoin de mon argent :-)

C'est donc parti pour Zotero, et je vais commencer à l'alimenter avec l'ensemble de mes recherches. Pas certains que je trouverai le temps de tout basculer, mais je vais plutôt l'utiliser au fil de l'eau à partir de maintenant. Et je vous ferai bien sur un retour sur mon expérience.

Et si vous voulez voir cela en vidéo, en quelques minutes, voici le lien : http://www.zotero.org/support/quick_start_guide

Problème du jour : Comment représenter 1 valeur par minute, pendant les 7 heures quotidiennes d'ouverture des 14 bourses américaines, pendant 5 ans ? et faire en sorte que le graphique fasse passer un message...

Faites le calcul, ce n'est pas du big data ! Juste 10 731 000 valeurs (environ) à représenter.

Rien de bien compliqué... apparemment... car une des facettes du big data que je développerai dans le livre est un "V" supplémentaire, celui de la visualisation.

Si ces données sont le nombre d'opérations automatisées passées sur le marché financier américain, pendant ces cinq dernières années, jour par jour, c'est leur comparaison qui devient intéressante.

Et c'est là que le graphique dynamique parle. En regardant l'animation ci-dessous, vous constaterez comme moi que le volume des transactions automatisées était très raisonnable en 2007 et qu'il a pris ces dernières années des proportions inquiétantes. Certains disent qu'il faut y voir une des raisons de la crise financière et des variations excessives que connaissent les marchés et qui font la joie de Thomas Blar ! Ce n'est pas mon propos ici :-)

Pour représenter des données qui contiennent un axe temporel, il ne faut pas hésiter à utiliser des graphiques dynamiques. Le mouvement représente le temps - la date est d'ailleurs bien indiquée en bas à gauche. Et l'accélération du temps fait prendre conscience du phénomène.

Faut-il des outils complexes et coûteux pour y parvenir ? Pas du tout ! Cette animation est un simple fichier "gif animé", c'est à dire une succession d'images fixes, que le gif animé fait défiler à vitesse rapide. Tout comme la roue de Faraday en 1830, le gif animé joue sur la persistence rétinienne pour faire croire à l'oeil qu'on lui présente un mouvement alors qu'il ne s'agit que d'une suite d'images fixes.

Pas besoin de logiciels couteux et complexes, avec un peu d'imagination, vous pourrez vous aussi animer vos images.

Faire du big data, c'est bien sur collecter, stocker et analyser de grandes quantités de données, mais c'est aussi les représenter sous forme graphique le plus souvent, afin d'en faire comprendre le message à son public. Je crois beaucoup à la force du "V" de la visualisation !

Faites le calcul, ce n'est pas du big data ! Juste 10 731 000 valeurs (environ) à représenter.

Rien de bien compliqué... apparemment... car une des facettes du big data que je développerai dans le livre est un "V" supplémentaire, celui de la visualisation.

Si ces données sont le nombre d'opérations automatisées passées sur le marché financier américain, pendant ces cinq dernières années, jour par jour, c'est leur comparaison qui devient intéressante.

Et c'est là que le graphique dynamique parle. En regardant l'animation ci-dessous, vous constaterez comme moi que le volume des transactions automatisées était très raisonnable en 2007 et qu'il a pris ces dernières années des proportions inquiétantes. Certains disent qu'il faut y voir une des raisons de la crise financière et des variations excessives que connaissent les marchés et qui font la joie de Thomas Blar ! Ce n'est pas mon propos ici :-)

Pour représenter des données qui contiennent un axe temporel, il ne faut pas hésiter à utiliser des graphiques dynamiques. Le mouvement représente le temps - la date est d'ailleurs bien indiquée en bas à gauche. Et l'accélération du temps fait prendre conscience du phénomène.

Faut-il des outils complexes et coûteux pour y parvenir ? Pas du tout ! Cette animation est un simple fichier "gif animé", c'est à dire une succession d'images fixes, que le gif animé fait défiler à vitesse rapide. Tout comme la roue de Faraday en 1830, le gif animé joue sur la persistence rétinienne pour faire croire à l'oeil qu'on lui présente un mouvement alors qu'il ne s'agit que d'une suite d'images fixes.

Pas besoin de logiciels couteux et complexes, avec un peu d'imagination, vous pourrez vous aussi animer vos images.

Faire du big data, c'est bien sur collecter, stocker et analyser de grandes quantités de données, mais c'est aussi les représenter sous forme graphique le plus souvent, afin d'en faire comprendre le message à son public. Je crois beaucoup à la force du "V" de la visualisation !

Ma mère me disait toujours qu'un bon ouvrier se devait d'avoir de bons outils, et bien entretenus. Lorsque ma trousse d'écolier n'était pas complète ou que mes cahiers étaient abimés, je me faisais réprimander. Mais le même argument me permettait d'avoir à la rentrée des accessoires d'étude de bonne qualité.

A l'inverse, de bons outils ne font pas un bon ouvrier. Mais la combinaison des deux doit être recherchée.

Parmi les personnes que je rencontre, une majorité semble admirative devant l'idée d'écrire un livre de 250 pages. Il est vrai qu'à l'heure du web, beaucoup ont du mal à lire plus de deux pages, et sont obligés de sous-traiter lorsqu'il s'agit de rédiger quelques pages… Mais ne vous inquiétez pas, l'écriture est mon métier. Alors certes, écrire 250 pages est plus long et prenant que d'écrire 2 pages, mais c'est beaucoup plus facile et rapide que d'écrire 125 fois deux pages !

Pour cela il faut un bon outil. Et comme je l'expliquais avant-hier dans mon billet, l'écriture n'est pas linéaire. Un logiciel de traitement de texte est lui, justement linéaire. Et réorganiser les idées, les paragraphes, les chapitres, suppose de jongler entre les copier-coller. Même le "mode plan" de Word se révèle rapidement inadapté à des textes de plusieurs centaines de pages.

Par ailleurs, il faut collecter et suivre tout le travail de recherche, d'interviews, de collecte de documents, etc. C'est le rôle de "chef de projet" que j'évoquais hier.

Pour tout cela, j'ai retenu un outil professionnel adapté à ces tâches, Scrivener. Il ne coûte que 45 dollars US et la dernière version, compatible Mac et Windows, gère tout ce dont j'ai besoin :

- un dossier "recherches" dans lequel chaque interview est notée, accompagnée de méta-données sur la date prévue, les contacts, l'environnement, etc;

- un dossier "brouillon" dans lequel les morceaux de textes sont conservés, classés et réorganisés à volonté avec plusieurs niveaux de chapitres et sous-chapitres;

- un mode "tableau de liège" où les idées peuvent être "punaisées", réorganisées, et où chaque idée peut être accompagnée d'un mini-synopsis;

- la "compilation" de l'ensemble du dossier brouillon donne le texte final.

Accompagné de ma fidèle DropBox, où sont stockés l'ensemble des documents de mon livre, Scrivener me permet d'accéder à la dernière version de mon projet depuis mon Mac de bureau ou depuis mon Mac portable.

Bien sur le processus de sauvegardes a mon attention quotidienne, et j'ai prévu ceinture, bretelles et plus encore. Vous n'imaginez pas le risque que représente la perte d'un texte de plusieurs centaines de pages déjà rédigées. Temps perdu bien sur, mais surtout motivation à zéro qui conduit le plus souvent à l'abandon total du projet. Donc en ce qui me concerne, à part en cas de guerre nucléaire mondiale, mon projet devrait rester à l'abri.

Mais le plus intéressant reste l'apprentissage de l'utilisation de Scrivener, que j'adopterai maintenant également sur de plus petits projets tels que les livres blancs. Il aide véritablement à organiser ses idées, et surtout permet de cumuler les pages, sans avoir véritablement l'impression d'écrire de longs textes. Si vous voulez le découvrir, regardez la petite vidéo ci-dessous.

Diviser la tâche pour mieux l'appréhender, cela faisait également partie des conseils de ma mère !

Pour cela il faut un bon outil. Et comme je l'expliquais avant-hier dans mon billet, l'écriture n'est pas linéaire. Un logiciel de traitement de texte est lui, justement linéaire. Et réorganiser les idées, les paragraphes, les chapitres, suppose de jongler entre les copier-coller. Même le "mode plan" de Word se révèle rapidement inadapté à des textes de plusieurs centaines de pages.

Par ailleurs, il faut collecter et suivre tout le travail de recherche, d'interviews, de collecte de documents, etc. C'est le rôle de "chef de projet" que j'évoquais hier.

Pour tout cela, j'ai retenu un outil professionnel adapté à ces tâches, Scrivener. Il ne coûte que 45 dollars US et la dernière version, compatible Mac et Windows, gère tout ce dont j'ai besoin :

- un dossier "recherches" dans lequel chaque interview est notée, accompagnée de méta-données sur la date prévue, les contacts, l'environnement, etc;

- un dossier "brouillon" dans lequel les morceaux de textes sont conservés, classés et réorganisés à volonté avec plusieurs niveaux de chapitres et sous-chapitres;

- un mode "tableau de liège" où les idées peuvent être "punaisées", réorganisées, et où chaque idée peut être accompagnée d'un mini-synopsis;

- la "compilation" de l'ensemble du dossier brouillon donne le texte final.

Accompagné de ma fidèle DropBox, où sont stockés l'ensemble des documents de mon livre, Scrivener me permet d'accéder à la dernière version de mon projet depuis mon Mac de bureau ou depuis mon Mac portable.

Bien sur le processus de sauvegardes a mon attention quotidienne, et j'ai prévu ceinture, bretelles et plus encore. Vous n'imaginez pas le risque que représente la perte d'un texte de plusieurs centaines de pages déjà rédigées. Temps perdu bien sur, mais surtout motivation à zéro qui conduit le plus souvent à l'abandon total du projet. Donc en ce qui me concerne, à part en cas de guerre nucléaire mondiale, mon projet devrait rester à l'abri.

Mais le plus intéressant reste l'apprentissage de l'utilisation de Scrivener, que j'adopterai maintenant également sur de plus petits projets tels que les livres blancs. Il aide véritablement à organiser ses idées, et surtout permet de cumuler les pages, sans avoir véritablement l'impression d'écrire de longs textes. Si vous voulez le découvrir, regardez la petite vidéo ci-dessous.

Diviser la tâche pour mieux l'appréhender, cela faisait également partie des conseils de ma mère !

Peut-être étiez-vous comme moi devant votre écran d'ordinateur il y a quelques minutes pour vivre en direct un grand moment de l'histoire spatiale, celle de la descente du robot Curiosity sur le sol de Mars. L'événement, retransmis en direct par la NASA sur Internet, s'est parfaitement déroulé et la satisfaction se lisait sur les sourires des dizaines d'ingénieurs qui voyaient en quelques secondes couronnées plusieurs années de travail.

Passons sur cette retransmission en direct qui a permis à environ 145 000 internautes de suivre en direct cet événement; hier réservées aux invités spéciaux, les images du centre de contrôle de la NASA sont maintenant ouvertes à tous, en direct, et chacun peut vivre l'événement. Cette mise à disposition de données au public est un progrès fabuleux, pour le savoir, et pour la démocratisation des sciences auprès du public.

Mais revenons à notre sujet, le big data. Car l'analyse de cet événement sous l'angle des données est intéressant; et nous permettra d'une part de relativiser, d'autre part de comparer quelques chiffres… Les spécialistes du sujet qui tomberaient sur cet article me pardonneront certaines imprécisions. Je ne suis pas un spécialiste du domaine. Mais n'hésitez pas à me corriger !

Ce qui frappe tout d'abord c'est la distance. Mars%C3%A8te) est une planète située en environ 55,7 millions de kilomètres de la Terre. Il aura fallu un peu plus de huit mois à Curiosity pour parcourir cette distance, soit une vitesse moyenne de l'ordre de 10 400 km/h, si je ne me trompe pas dans mes calculs.

Mais la communication à une telle distance pose quelques problèmes bien spécifiques. Il est déjà incroyable pour les simples mortels que nous sommes, d'imaginer que l'on puisse envoyer des données à 56 millions de kilomètres de distance et qu'elles nous parviennent. Mais ces données mettent 13 minutes 46 à rejoindre nos oreilles électroniques. Elles voyagent donc à la vitesse incroyable de 243 millions de km/h ! Elles passent pour cela par des satellites qui relaient les informations vers la terre, en particulier afin de faire économiser de l'énergie à Curiosity qui dispose néanmoins d'un canal direct de communication avec la terre.

Un délai qui fait que les informations ou images reçues par le centre de contrôle de la Nasa dataient finalement de 13 minutes 46 auparavant. Comme l'a fait remarquer un commentateur, avec ce décalage, pendant que les ingénieurs attendaient les données, Curiosity avait soit déjà posé ses pattes sur le sol martien, soit s'y était écrasé, et ils n'avaient aucun moyen de le savoir, si ce n'est d'attendre ce délai nécessaire à la transmission des données sur cette distance.

Le flux de données est également réduit. N'imaginez pas transmettre des giga-octets de données par seconde sur cette distance. C'est une simple communication à 8 Ko/s qui relie Curiosity à sa planète d'origine. Et c'est par ce flux de 8 Ko/s que sont transmises les données techniques, et les images que le robot nous envoie de la planète Mars. Des images là encore contraintes par la distance, 64 pixels de côté pour les premières vignettes, puis de "grandes" photos de 256 pixels de coté. Mais une photo de 256 pixels de large en noir et blanc, non compressée, c'est tout de même 64 Ko soit 8 secondes de transmission à 8 Ko/s. Tout est donc vraiment relatif.

Faut-il alors considérer que les données envoyées par Curiosity relèvent du Big Data ?

- Elles sont bien de différents formats (données structurées, images…)

- La vitesse est bien présente - à 243 millions de km/h je pense que l'on peut l'accorder :-)

- quant au volume… même si le robot communiquera certainement pendant au moins une année martienne (soit 687 de nos jours), cela ne devrait représenter, à 8 Ko/s, que 475 millions de Ko - 475 Go "seulement" en deux ans. Pas vraiment du big data !

Mais ce facteur supplémentaire de la distance et du délai de transmission mérite-t-il que l'on classe cette application dans la catégorie du Big Data ? Le débat est ouvert, dites-moi ce que vous en pensez !

Pour découvrir les photos prises par Curiosity sur le sol de Mars et envoyées à la terre : http://mars.jpl.nasa.gov/msl/multimedia/raw/

Mais revenons à notre sujet, le big data. Car l'analyse de cet événement sous l'angle des données est intéressant; et nous permettra d'une part de relativiser, d'autre part de comparer quelques chiffres… Les spécialistes du sujet qui tomberaient sur cet article me pardonneront certaines imprécisions. Je ne suis pas un spécialiste du domaine. Mais n'hésitez pas à me corriger !

Ce qui frappe tout d'abord c'est la distance. Mars%C3%A8te) est une planète située en environ 55,7 millions de kilomètres de la Terre. Il aura fallu un peu plus de huit mois à Curiosity pour parcourir cette distance, soit une vitesse moyenne de l'ordre de 10 400 km/h, si je ne me trompe pas dans mes calculs.

Mais la communication à une telle distance pose quelques problèmes bien spécifiques. Il est déjà incroyable pour les simples mortels que nous sommes, d'imaginer que l'on puisse envoyer des données à 56 millions de kilomètres de distance et qu'elles nous parviennent. Mais ces données mettent 13 minutes 46 à rejoindre nos oreilles électroniques. Elles voyagent donc à la vitesse incroyable de 243 millions de km/h ! Elles passent pour cela par des satellites qui relaient les informations vers la terre, en particulier afin de faire économiser de l'énergie à Curiosity qui dispose néanmoins d'un canal direct de communication avec la terre.

Un délai qui fait que les informations ou images reçues par le centre de contrôle de la Nasa dataient finalement de 13 minutes 46 auparavant. Comme l'a fait remarquer un commentateur, avec ce décalage, pendant que les ingénieurs attendaient les données, Curiosity avait soit déjà posé ses pattes sur le sol martien, soit s'y était écrasé, et ils n'avaient aucun moyen de le savoir, si ce n'est d'attendre ce délai nécessaire à la transmission des données sur cette distance.

Le flux de données est également réduit. N'imaginez pas transmettre des giga-octets de données par seconde sur cette distance. C'est une simple communication à 8 Ko/s qui relie Curiosity à sa planète d'origine. Et c'est par ce flux de 8 Ko/s que sont transmises les données techniques, et les images que le robot nous envoie de la planète Mars. Des images là encore contraintes par la distance, 64 pixels de côté pour les premières vignettes, puis de "grandes" photos de 256 pixels de coté. Mais une photo de 256 pixels de large en noir et blanc, non compressée, c'est tout de même 64 Ko soit 8 secondes de transmission à 8 Ko/s. Tout est donc vraiment relatif.

Faut-il alors considérer que les données envoyées par Curiosity relèvent du Big Data ?

- Elles sont bien de différents formats (données structurées, images…)

- La vitesse est bien présente - à 243 millions de km/h je pense que l'on peut l'accorder :-)

- quant au volume… même si le robot communiquera certainement pendant au moins une année martienne (soit 687 de nos jours), cela ne devrait représenter, à 8 Ko/s, que 475 millions de Ko - 475 Go "seulement" en deux ans. Pas vraiment du big data !

Mais ce facteur supplémentaire de la distance et du délai de transmission mérite-t-il que l'on classe cette application dans la catégorie du Big Data ? Le débat est ouvert, dites-moi ce que vous en pensez !

Pour découvrir les photos prises par Curiosity sur le sol de Mars et envoyées à la terre : http://mars.jpl.nasa.gov/msl/multimedia/raw/

Certaines personnes rencontrées pour la préparation de mon livre me questionnent sur les outils que j'utilise, mais elles sont finalement rares. La plupart imagine sans doute qu'un simple traitement de texte fera l'affaire; et que les pages vont s'enchainer les unes aux autres, comme par magie. Que nenni… L'écriture d'un livre professionnel n'a pas grand chose à voir avec le miracle de l'écriture créative.

J'ai la chance de connaître une excellente auteure de romans noirs, Ingrid Desjours. Souvent elle me parle de ses périodes d'écriture, lorsque le monde lui devient étranger, et qu'elle plonge avec ses personnages dans un triolisme effréné, cerveau, doigts et clavier. Enfermée dans sa grotte, elle gratte ou plutôt tape pendant des heures, pour accoucher de ses textes… Impressionnant !

J'en suis très loin, et l'écriture d'un livre professionnel s'apparente plus à un travail de chef de projet et d'ouvrier qualifié qu'à une quelconque création artistique.

Tout d'abord l'écriture n'est pas linéaire. Je ne raconte pas une histoire, je synthétise des savoirs, des connaissances, des idées. Et je n'ai d'ailleurs à ce stade qu'une idée imprécise du plan du livre "Big Data". Cela n'a aucune importance. Car j'écris morceau par morceau. Hier j'ai rédigé un chapitre complet sur le big data dans l'industrie des télécommunications. Où sera-t-il finalement placé dans le livre ? Aucune idée. Et pendant son écriture, il y a au moins trois ou quatre autres idées de sous-chapitres ou d'éléments à ajouter ailleurs dans le livre qui me sont venues. Je les ai notées, et j'y reviendrai par la suite. Inversement, lorsque demain je travaillerai sur l'interview d'un expert de l'analyse prédictive, il me parlera certainement à nouveau du secteur des télécommunications. Je rajouterai alors de la matière au chapitre ad-hoc. Plutôt que d'être angoissé par la feuille blanche en me disant "plus que 250 pages…", j'accumule les morceaux rédigés. Puis je les mets en ordre. Viendra ensuite, à la fin, le temps de la relecture et de l'harmonisation. Mais nous n'en sommes pas là.

Rédiger un livre professionnel est donc essentiellement un travail de chef de projet : définir des tâches, les segmenter, les répartir, les documenter, veiller à leur exécution… et d'ouvrier, car chaque jour, je dois m'atteler à la rédaction d'un ou de plusieurs chapitres. Inspiration ou pas, il faut produire. Parfois ça sort tout seul, parfois l'accouchement est difficile. Gros avantage de ce type de naissance, si le bébé n'est pas beau, on peut le jeter et en refaire un autre !

Ne me demandez donc pas si je suis inspiré. Mais plutôt si j'ai été productif. Oh! Ce ne sera pas de la grande littérature, et ce n'est d'ailleurs pas ce que me demanderont mes futurs lecteurs. Mais du pragmatisme. Expliquer des idées parfois complexes avec des mots simples. Faire que le lecteur ait appris quelques petites choses à la fin de sa lecture et qu'il n'ait pas passé un trop mauvais moment.

Comment d'ailleurs jugerais-je de la qualité de ma production ? Tout simplement si certains lecteurs me disent avoir compris le sujet, ou mieux avoir trouvé ne serait-ce qu'une idée à mettre en pratique dans leur organisation. Quant à celui qui me dira avoir dévoré mon livre en une nuit tellement l'intrigue le prenait au tripes, je ne le croirai pas ! Il aura sans doute confondu.

J'en suis très loin, et l'écriture d'un livre professionnel s'apparente plus à un travail de chef de projet et d'ouvrier qualifié qu'à une quelconque création artistique.

Tout d'abord l'écriture n'est pas linéaire. Je ne raconte pas une histoire, je synthétise des savoirs, des connaissances, des idées. Et je n'ai d'ailleurs à ce stade qu'une idée imprécise du plan du livre "Big Data". Cela n'a aucune importance. Car j'écris morceau par morceau. Hier j'ai rédigé un chapitre complet sur le big data dans l'industrie des télécommunications. Où sera-t-il finalement placé dans le livre ? Aucune idée. Et pendant son écriture, il y a au moins trois ou quatre autres idées de sous-chapitres ou d'éléments à ajouter ailleurs dans le livre qui me sont venues. Je les ai notées, et j'y reviendrai par la suite. Inversement, lorsque demain je travaillerai sur l'interview d'un expert de l'analyse prédictive, il me parlera certainement à nouveau du secteur des télécommunications. Je rajouterai alors de la matière au chapitre ad-hoc. Plutôt que d'être angoissé par la feuille blanche en me disant "plus que 250 pages…", j'accumule les morceaux rédigés. Puis je les mets en ordre. Viendra ensuite, à la fin, le temps de la relecture et de l'harmonisation. Mais nous n'en sommes pas là.

Rédiger un livre professionnel est donc essentiellement un travail de chef de projet : définir des tâches, les segmenter, les répartir, les documenter, veiller à leur exécution… et d'ouvrier, car chaque jour, je dois m'atteler à la rédaction d'un ou de plusieurs chapitres. Inspiration ou pas, il faut produire. Parfois ça sort tout seul, parfois l'accouchement est difficile. Gros avantage de ce type de naissance, si le bébé n'est pas beau, on peut le jeter et en refaire un autre !

Ne me demandez donc pas si je suis inspiré. Mais plutôt si j'ai été productif. Oh! Ce ne sera pas de la grande littérature, et ce n'est d'ailleurs pas ce que me demanderont mes futurs lecteurs. Mais du pragmatisme. Expliquer des idées parfois complexes avec des mots simples. Faire que le lecteur ait appris quelques petites choses à la fin de sa lecture et qu'il n'ait pas passé un trop mauvais moment.

Comment d'ailleurs jugerais-je de la qualité de ma production ? Tout simplement si certains lecteurs me disent avoir compris le sujet, ou mieux avoir trouvé ne serait-ce qu'une idée à mettre en pratique dans leur organisation. Quant à celui qui me dira avoir dévoré mon livre en une nuit tellement l'intrigue le prenait au tripes, je ne le croirai pas ! Il aura sans doute confondu.

Certes, ce n'est pas une question de taille... et je m'attache chaque jour à expliquer que le volume de données ne fait pas tout, et que la variété et le vitesse sont les deux critères complémentaires qui définissent le "big data".

Mais tout de même, il y a des volumes qui impressionnent. Ayant entrepris de télécharger le nouvel OS Apple, Moutain Lion sur mon nouveau Macbook Air - dont l'écriture de ce livre m'a donné l'excuse à ma conscience pour en justifier l'acquisition - je constate que ce téléchargement représente 4,34 Go. Autant dire qu'il fait souffrir ma connexion ADSL campagnarde à 1 Mb/s... quand il ne peut pas...

Mais je fais le lien avec les chiffres annoncés il y a quelques jours par Apple. Le constructeur était en effet fier d'annoncer qu'en quatre jours, trois millions de clients avaient téléchargé Mountain Lion.

Je vous avoue qu'il m'a fallu sortir de son étui ma calculatrice HP 17BII pour tenter de faire la multiplication. Je vous livre mes calculs, car je ne suis même pas certain de ne pas avoir commis quelque erreur... Merci Wikipedia

4,34 Go x 3 000 000 de téléchargements = 13 020 000 Go... ça c'est facile !

1 Go = 10 puissance 9 octets...

Donc 13 020 000 Go = 13 puissance 15 octets

Soit si j'ai bien compris 13 Po !

Apple a consommé 13 Po de bande passante en 4 jours juste pour le téléchargement de la nouvelle version de son OS par ses clients.

Est-ce beaucoup ou pas ? Quelle est la bande passante mondiale disponible ? Quelle part des "tuyaux" a consommé Apple ? Et cela coute combien au constructeur ?

Je me pose de nombreuses questions... en regrettant quand même pendant que je regarde mon Mac annoncer 7 heures de téléchargement, le système des DVD ou des clefs USB...

Ceci étant, pour les nostalgiques qui pestaient quand Word et Excel étaient livrés sur plusieurs disquettes 3"1/2, Mac OS Mountain Lion aurait nécessité la fabrication de 10 850 000 000 disquettes de 1,2 Mo... et vous auriez chacun reçu 3616 disquettes pour l'installation !

Mais tout de même, il y a des volumes qui impressionnent. Ayant entrepris de télécharger le nouvel OS Apple, Moutain Lion sur mon nouveau Macbook Air - dont l'écriture de ce livre m'a donné l'excuse à ma conscience pour en justifier l'acquisition - je constate que ce téléchargement représente 4,34 Go. Autant dire qu'il fait souffrir ma connexion ADSL campagnarde à 1 Mb/s... quand il ne peut pas...

Mais je fais le lien avec les chiffres annoncés il y a quelques jours par Apple. Le constructeur était en effet fier d'annoncer qu'en quatre jours, trois millions de clients avaient téléchargé Mountain Lion.

Je vous avoue qu'il m'a fallu sortir de son étui ma calculatrice HP 17BII pour tenter de faire la multiplication. Je vous livre mes calculs, car je ne suis même pas certain de ne pas avoir commis quelque erreur... Merci Wikipedia

4,34 Go x 3 000 000 de téléchargements = 13 020 000 Go... ça c'est facile !

1 Go = 10 puissance 9 octets...

Donc 13 020 000 Go = 13 puissance 15 octets

Soit si j'ai bien compris 13 Po !

Apple a consommé 13 Po de bande passante en 4 jours juste pour le téléchargement de la nouvelle version de son OS par ses clients.

Est-ce beaucoup ou pas ? Quelle est la bande passante mondiale disponible ? Quelle part des "tuyaux" a consommé Apple ? Et cela coute combien au constructeur ?

Je me pose de nombreuses questions... en regrettant quand même pendant que je regarde mon Mac annoncer 7 heures de téléchargement, le système des DVD ou des clefs USB...

Ceci étant, pour les nostalgiques qui pestaient quand Word et Excel étaient livrés sur plusieurs disquettes 3"1/2, Mac OS Mountain Lion aurait nécessité la fabrication de 10 850 000 000 disquettes de 1,2 Mo... et vous auriez chacun reçu 3616 disquettes pour l'installation !

Au hasard de mes recherches et de ma veille sur l'actualité du big data, je tombe régulièrement sur des perles... je ne parle pas de pépites car celles-ci méritent des applaudissements et il y en a; mais de perles, venant en particulier de tous ceux qui se contentent d'ajouter le mot "big data" à une phrase pour tenter de lui donner une connotation plus "moderne". C'est bien dommage... car ce ne sert en rien les intérêts de la marque en question qui se dévalorise en employant sans raison ce terme; et cela ne sert en rien les utilisateurs, qui ne voient dans cette surabondance d'usage qu'une confusion de plus, excellente excuse pour retarder leurs investissements.

Sans doute les mêmes s'appelaient ils ".com" en 2000, "2.0" en 2005, "cloud en 2010"... et "big data" aujourd'hui...

Au programme de ma cueillette, je vous propose :

- Quantum qui se présente maintenant de la manière suivante : "Quantum Corp. (NYSE : QTM), spécialiste mondial incontesté de la protection des données et de la gestion des Big Data..."... Ca se saurait... Spielberg aurait fait un film...

- Kaseya, dont le métier, fort respectable au demeurant est de développer des anti-virus, anti-malware... qui comme par hasard aujourd'hui se sont fixés comme mission principale de "protéger les big data"... "«La solution Kaseya IT Management peut faire en sorte que les clients soient en mesure de travailler et de gérer leurs Big Data sans problèmes.

"La solution comprend des modules antivirus (KAV / KES) et anti-malware (KAM) pour sécuriser les Big Data des clients confrontés à des machines infectées. Le module Desktop Policy Management (KDPM) assure la conformité avec un accès standard et les mesures de sécurité nécessaires, tandis que la gestion des patchs assure que les équipements des clients sont à jour contre les vulnérabilités identifiées qui peuvent être exploitées pour obtenir un accès non autorisé à des Big Data confidentielles. Enfin, le module de sauvegarde de fichiers et de dossiers (KDB) permet le transfert sécurisé et la sauvegarde de données dans n'importe quel format de fichier"... vous aurez remarqué qu'un simple "chercher / remplacer" aura permis dans Word de reprendre un ancien texte, et de remplacer "données" par "big data" pour se donner un coup de jeune.

Tout cela me fait penser aux produits cosmétiques censés faire rajeunir. En regardant les publicités avec attention, vous noterez une mention devenue obligatoire "couches supérieures de l'épiderme"... Ne faudrait-il pas appliquer la même règle au big data et que ces opportunistes de la communication soient obligés d'indiquer que leur produit n'a d'action que "sur la couche supérieure de vos données" ?

Sans doute les mêmes s'appelaient ils ".com" en 2000, "2.0" en 2005, "cloud en 2010"... et "big data" aujourd'hui...

Au programme de ma cueillette, je vous propose :

- Quantum qui se présente maintenant de la manière suivante : "Quantum Corp. (NYSE : QTM), spécialiste mondial incontesté de la protection des données et de la gestion des Big Data..."... Ca se saurait... Spielberg aurait fait un film...

- Kaseya, dont le métier, fort respectable au demeurant est de développer des anti-virus, anti-malware... qui comme par hasard aujourd'hui se sont fixés comme mission principale de "protéger les big data"... "«La solution Kaseya IT Management peut faire en sorte que les clients soient en mesure de travailler et de gérer leurs Big Data sans problèmes.

"La solution comprend des modules antivirus (KAV / KES) et anti-malware (KAM) pour sécuriser les Big Data des clients confrontés à des machines infectées. Le module Desktop Policy Management (KDPM) assure la conformité avec un accès standard et les mesures de sécurité nécessaires, tandis que la gestion des patchs assure que les équipements des clients sont à jour contre les vulnérabilités identifiées qui peuvent être exploitées pour obtenir un accès non autorisé à des Big Data confidentielles. Enfin, le module de sauvegarde de fichiers et de dossiers (KDB) permet le transfert sécurisé et la sauvegarde de données dans n'importe quel format de fichier"... vous aurez remarqué qu'un simple "chercher / remplacer" aura permis dans Word de reprendre un ancien texte, et de remplacer "données" par "big data" pour se donner un coup de jeune.

Tout cela me fait penser aux produits cosmétiques censés faire rajeunir. En regardant les publicités avec attention, vous noterez une mention devenue obligatoire "couches supérieures de l'épiderme"... Ne faudrait-il pas appliquer la même règle au big data et que ces opportunistes de la communication soient obligés d'indiquer que leur produit n'a d'action que "sur la couche supérieure de vos données" ?

> A LIRE EN CE MOMENT SUR DECIDEO

-

Cartographier les flux de données : un nouvel impératif de gouvernance

Cartographier les flux de données : un nouvel impératif de gouvernance

-

Marionnaud sélectionne Equadis pour acquérir l’ensemble des données produit de ses partenaires et vise 100% de qualité de données produit

Marionnaud sélectionne Equadis pour acquérir l’ensemble des données produit de ses partenaires et vise 100% de qualité de données produit

-

Snowflake renforce sa collaboration avec AWS avec un investissement de 6 milliards de dollars

Snowflake renforce sa collaboration avec AWS avec un investissement de 6 milliards de dollars

-

Starburst dévoile l’Enterprise Intelligence Platform à AI+Datanova, offrant aux entreprises une voie plus rapide vers une IA de confiance

Starburst dévoile l’Enterprise Intelligence Platform à AI+Datanova, offrant aux entreprises une voie plus rapide vers une IA de confiance

-

Veeam renforce la confiance dans les données avec la nouvelle version de la Veeam Data Platform, présentée en avant-première au VeeamON (New York)

Veeam renforce la confiance dans les données avec la nouvelle version de la Veeam Data Platform, présentée en avant-première au VeeamON (New York)

-

Un an après sa création, Myriade s'impose dans l'analytique IA des grandes entreprises

Un an après sa création, Myriade s'impose dans l'analytique IA des grandes entreprises

-

Scality s’impose comme l’acteur clé du stockage informatique des hôpitaux français

Scality s’impose comme l’acteur clé du stockage informatique des hôpitaux français

-

Podcast : Mauvaise gouvernance ? Faut-il empêcher ou interdire ?

Podcast : Mauvaise gouvernance ? Faut-il empêcher ou interdire ?

-

SAP dévoile l’Entreprise Autonome

SAP dévoile l’Entreprise Autonome

-

Celonis lance Context Model pour éliminer les angles morts opérationnels de l’IA d’entreprise et annonce l’acquisition d’Ikigai Labs, leader de l’intelligence décisionnelle alimentée par IA

Celonis lance Context Model pour éliminer les angles morts opérationnels de l’IA d’entreprise et annonce l’acquisition d’Ikigai Labs, leader de l’intelligence décisionnelle alimentée par IA

Partager ce site

Tags

Archives

Profil

Je suis journaliste, formateur et auteur, spécialiste de l'informatique décisionnelle. Passionné par l'évolution de ce domaine vers le "Big Data", également appelé "Données Volumineuses", j'ai décidé d'écrire un livre en français sur le sujet, peut-être le premier. Etudes de cas, panorama des outils, vision des experts... et les coulisses de la production du livre, que je vous propose de découvrir au fil de ces billets.

Philippe NIEUWBOURG

Philippe NIEUWBOURG

Dernières notes