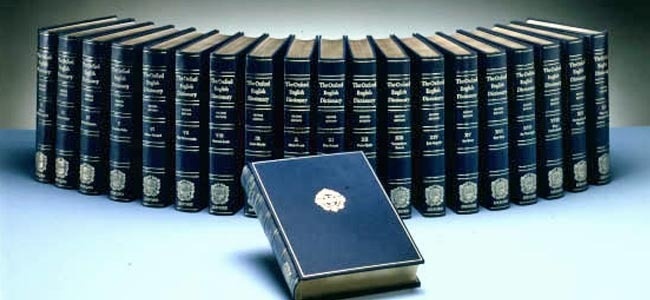

C'est officiel, le terme "Big Data" vient d'être ajouté au prestigieux Oxford English Dictionary. Une définition qui valide et borne l'usage de cette expression. Voici la définition retenue : "big data n. Computing (also with capital initials) data of a very large size, typically to the extent that its manipulation and management present significant logistical challenges; (also) the branch of computing involving such data".

On peut bien sur regretter que seul le volume des données concernées soit retenu comme critère. Comme la notion de "very large size" a été, est et sera évolutive, le Big Data d'aujourd'hui sera le Small Data de demain.

A noter également trois citations reprises par le dictionnaire dont une qui remonte à 1980.

1980 C. Tilly Old New Social Hist. & New Old Social Hist. (CRSO Working Paper No. 218) 8 None of the big questions has actually yielded to the bludgeoning of the big-data people.

2003 R. Williams in F. Berman et al. Grid Computing xxxviii. 850 The recognition that big data is a gold mine and not just a collection of dusty tapes.

2012 Australian (Nexis) 9 Oct. 37 At the heart of Big Data are two open source technologies—the Hadoop open-source framework.., and the MapReduce programming model.

On peut bien sur regretter que seul le volume des données concernées soit retenu comme critère. Comme la notion de "very large size" a été, est et sera évolutive, le Big Data d'aujourd'hui sera le Small Data de demain.

A noter également trois citations reprises par le dictionnaire dont une qui remonte à 1980.

1980 C. Tilly Old New Social Hist. & New Old Social Hist. (CRSO Working Paper No. 218) 8 None of the big questions has actually yielded to the bludgeoning of the big-data people.

2003 R. Williams in F. Berman et al. Grid Computing xxxviii. 850 The recognition that big data is a gold mine and not just a collection of dusty tapes.

2012 Australian (Nexis) 9 Oct. 37 At the heart of Big Data are two open source technologies—the Hadoop open-source framework.., and the MapReduce programming model.

Par Philippe Nieuwbourg le Dimanche 16 Juin 2013

|

0 commentaire

> A LIRE EN CE MOMENT SUR DECIDEO

-

GS1 France aux côtés d’Equadis pour développer la solution « Data Quality Checker » garantissant l’échange de données de qualité sur le marché français

GS1 France aux côtés d’Equadis pour développer la solution « Data Quality Checker » garantissant l’échange de données de qualité sur le marché français

-

XXII lance RETAIL ANALYTICS, une innovation majeure pour le secteur du retail

XXII lance RETAIL ANALYTICS, une innovation majeure pour le secteur du retail

-

Salesforce dévoile une technologie intégrant l’IA pour extraire et structurer rapidement les données issues de documents et d’images

Salesforce dévoile une technologie intégrant l’IA pour extraire et structurer rapidement les données issues de documents et d’images

-

L’administration américaine va nommer ses premiers CAIO (Chief Artificial Intelligence Officer) et former ses comités de gouvernance

L’administration américaine va nommer ses premiers CAIO (Chief Artificial Intelligence Officer) et former ses comités de gouvernance

-

Podcast : les prompts sont des données, il va falloir les cataloguer

Podcast : les prompts sont des données, il va falloir les cataloguer

-

Neo4j : La nouvelle norme internationale GQL marque un tournant majeur pour l'industrie des bases de données

Neo4j : La nouvelle norme internationale GQL marque un tournant majeur pour l'industrie des bases de données

-

Gouverner l’intelligence artificielle : un passage obligé afin d’en sécuriser les bénéfices pour l’entreprise (1ère partie)

Gouverner l’intelligence artificielle : un passage obligé afin d’en sécuriser les bénéfices pour l’entreprise (1ère partie)

-

Etude Panasonic : la vision par ordinateur sera le fer de lance de la productivité de l'IA en 2024

Etude Panasonic : la vision par ordinateur sera le fer de lance de la productivité de l'IA en 2024

-

Étude Salesforce : Le manque de stratégie data entrave l'avancement de l'IA dans le secteur du Retail

Étude Salesforce : Le manque de stratégie data entrave l'avancement de l'IA dans le secteur du Retail

-

LF AI & Data Foundation lance Open Platform for Enterprise AI (OPEA) pour une collaboration innovante en matière d'IA d'entreprise

LF AI & Data Foundation lance Open Platform for Enterprise AI (OPEA) pour une collaboration innovante en matière d'IA d'entreprise

Partager ce site

Tags

Archives

Profil

Je suis journaliste, formateur et auteur, spécialiste de l'informatique décisionnelle. Passionné par l'évolution de ce domaine vers le "Big Data", également appelé "Données Volumineuses", j'ai décidé d'écrire un livre en français sur le sujet, peut-être le premier. Etudes de cas, panorama des outils, vision des experts... et les coulisses de la production du livre, que je vous propose de découvrir au fil de ces billets.

Philippe NIEUWBOURG

Philippe NIEUWBOURG

Dernières notes